Le mot "RAG" est partout. Sur LinkedIn, dans les pitchs de cabinets, dans les démos de salons. Tout le monde en parle, peu de monde sait quel problème ça résout vraiment en PME.

Cet article fait le tri. Cinq cas d'usage où le RAG en entreprise apporte un gain mesurable. Trois contextes où c'est au mieux inutile, au pire contre-productif. Et les pièges qui plantent un projet RAG une fois la démo finie.

RAG : ce que c'est vraiment, en 2 paragraphes pour décideur

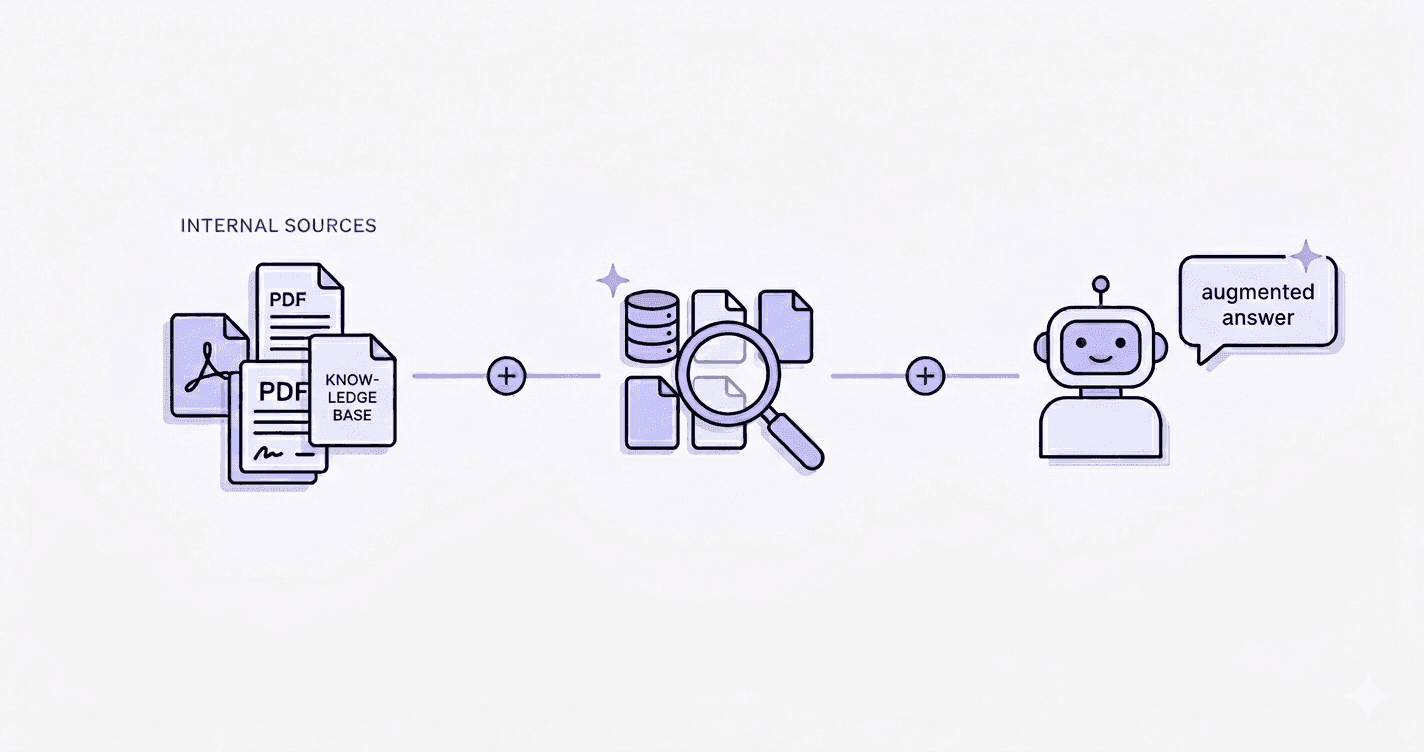

Un RAG (Retrieval Augmented Generation), c'est un LLM qui va d'abord chercher la bonne information dans vos documents, puis qui répond en s'appuyant dessus. Le "retrieval" récupère les passages pertinents dans votre base interne. La "generation" formule la réponse en langage naturel. Le LLM n'a pas appris vos données. Il les consulte au moment de répondre.

La différence avec un ChatGPT classique tient en une phrase : ChatGPT répond à partir de ce qu'il a vu pendant son entraînement. Un RAG répond à partir de vos documents à vous, ceux que ChatGPT n'a jamais vus. Vos contrats, votre doc technique, vos comptes-rendus, votre base RH. C'est ce qui le rend utile pour un usage interne, et c'est aussi ce qui le rend complexe à bien déployer.

Pourquoi le RAG est devenu un buzzword (et pourquoi c'est un problème)

Le RAG est vendu depuis 2024 comme la réponse universelle à "comment on met de l'IA dans notre boîte". Logique : c'est la brique la plus visible, celle qui donne lieu aux démos les plus impressionnantes. Une interface de chat, une question, une réponse fouillée dans 500 PDF. Effet "waouh" garanti pendant 20 minutes.

Le problème commence après la démo. Les POC RAG ont un taux d'échec en production qui ne ressemble pas à leur taux de succès en démo. Le retrieval ramène des passages hors-sujet. Le LLM hallucine sur les zones grises. Les équipes posent une question, reçoivent une réponse plausible mais fausse, et arrêtent d'utiliser l'outil au bout de trois semaines.

Le pire pattern que je vois passer : "on a fait un RAG sur notre doc interne". Aucune mesure du taux de réponses correctes. Aucun chiffre sur le gain de temps réel. Aucune indication sur ce que l'outil ne sait pas faire. C'est devenu une case à cocher de roadmap, pas un levier opérationnel.

Un RAG n'est pas un projet. C'est un outil. Si vous ne savez pas nommer la métrique qu'il doit faire bouger, vous n'avez pas un projet, vous avez une démo.

5 cas d'usage qui marchent vraiment

Voilà cinq contextes où un RAG bien déployé apporte un gain mesurable. Pas en théorie. En pratique observée chez des PME et ETI.

Documentation technique interne

À qui ça parle : équipes support, développeurs, chefs de produit, ingénieurs avant-vente. Toute équipe qui passe sa journée à fouiller dans une doc volumineuse.

Le problème : la doc technique grossit. Les versions s'empilent. Personne ne sait quelle page est à jour. Un nouvel arrivant met trois mois à devenir autonome, le temps de localiser l'information critique.

La solution RAG : interface de chat branchée sur l'ensemble de la doc (Confluence, Notion, Markdown, Google Docs). L'équipe pose une question en langage naturel, le système ramène la réponse avec les sources citées. Un développeur qui cherche "comment on configure le SSO sur l'instance pré-prod" obtient en 15 secondes ce qu'il aurait mis 20 minutes à trouver à la main.

Gain typique : 30 à 60 minutes par personne et par jour sur les rôles concernés. Sur une équipe de 20 ingénieurs, ça se mesure rapidement.

Base de connaissances RH

À qui ça parle : équipes RH, managers, et surtout les salariés qui posent toujours les mêmes questions.

Le problème : 80 % des sollicitations RH portent sur 20 questions récurrentes. Notes de frais, congés, mutuelle, télétravail, processus d'évaluation, démarches d'expatriation. Les RH passent un temps fou à répondre à des choses qui sont écrites dans un PDF que personne ne retrouve.

La solution RAG : un assistant interne, accessible dans Slack ou Teams, qui répond aux questions à partir des accords d'entreprise, des notes de service et de la convention collective. Réponse instantanée, avec la source citée.

Gain typique : 30 à 50 % du volume de sollicitations RH récurrentes traité en self-service. Les RH récupèrent du temps pour les sujets qui demandent vraiment du jugement humain.

Contrats et clauses

À qui ça parle : juridique, achats, direction commerciale, équipes compliance.

Le problème : retrouver une clause spécifique dans un parc de contrats hétérogène est un cauchemar. "Tous les contrats fournisseurs qui ont une clause d'exclusivité supérieure à 12 mois", "quels clients ont une clause de non-sollicitation du personnel", "quelles sont les pénalités de retard dans nos contrats logistiques". À la main, c'est plusieurs jours de travail.

La solution RAG : indexation de la base contractuelle, interrogation en langage naturel. Le système ramène les contrats concernés, les passages exacts, et la formulation des clauses.

Gain typique : passage d'une recherche en jours à une recherche en minutes. C'est aussi un outil qui réduit le risque, parce qu'on peut auditer un parc contractuel sans dépendre de la mémoire d'une ou deux personnes.

Devis et propositions commerciales

À qui ça parle : équipes commerciales, avant-vente, bid managers.

Le problème : chaque nouveau devis ressemble à un précédent. Mais retrouver le bon précédent, c'est l'enjeu. Les commerciaux refont 60 % du travail à chaque fois parce que personne ne sait où est rangée la proposition de 2024 qui ressemblait exactement au cas en cours.

La solution RAG : indexation de l'historique des propositions, avec recherche par contexte (secteur, taille du client, type de prestation). L'IA propose un assemblage de paragraphes réutilisables, le commercial valide, ajuste, envoie.

Gain typique : temps de rédaction d'une proposition divisé par deux à trois. Et meilleure cohérence dans le discours commercial, parce qu'on réutilise ce qui a déjà été validé.

Réponse à appels d'offres

À qui ça parle : équipes bid, commerciale, technique. Surtout dans les secteurs où l'appel d'offres est central (B2B services, secteur public, grands comptes).

Le problème : 70 % des questions d'un appel d'offres ont déjà été répondues dans un appel d'offres précédent. Mais les fichiers sont éparpillés, les rédacteurs ont changé, et tout le monde repart de zéro à chaque fois.

La solution RAG : base centralisée des réponses passées (techniques, RSE, sécurité, références), recherche par question, génération d'une première version de réponse qui s'appuie sur les meilleures formulations historiques.

Gain typique : temps de réponse à un appel d'offres divisé par deux, et taux de cohérence en hausse. C'est un des cas où le ROI est le plus net.

3 contextes où le RAG est inutile (ou pire)

Le RAG n'est pas une réponse universelle. Trois contextes où il vaut mieux passer son chemin.

Données qui changent toutes les heures. Si l'information que vos équipes cherchent évolue plusieurs fois par jour (cours, stocks, statuts de commande, disponibilités de planning), un RAG aura toujours un train de retard. Le temps d'indexer, l'info est déjà périmée. Pire, le LLM va répondre avec assurance sur une donnée obsolète. Pour ces cas, ce qu'il faut, c'est un accès direct à la source via API, pas un RAG.

Volume documentaire faible. En dessous de 50 documents pertinents, le RAG est sur-dimensionné. Un LLM moderne (Claude, GPT-4) accepte 100 000 à 200 000 tokens de contexte. Vous pouvez lui balancer toute votre doc en entrée directe et obtenir une meilleure qualité de réponse, sans la complexité du retrieval. Le RAG est utile quand vous avez trop de doc pour tout passer en contexte, pas quand vous en avez peu.

Réponses qui exigent du calcul ou du raisonnement, pas de la récupération. Une question comme "combien de clients ont généré plus de 100k€ ce trimestre" n'est pas un problème de RAG, c'est un problème SQL. Une question comme "quel est le meilleur moyen d'optimiser cette fonction Python" n'est pas un problème de RAG, c'est un problème de code review. Le RAG va chercher dans des textes. Si la réponse demande de calculer, agréger, ou raisonner sur des données structurées, c'est une autre architecture qu'il vous faut.

Architecture minimale d'un RAG utile (vulgarisé)

Sans entrer dans le détail technique, un RAG repose sur trois briques :

- Ingestion : on aspire vos documents (PDF, Word, pages web, contenus Notion ou Confluence), on les nettoie, on les découpe en morceaux exploitables (le fameux "chunking").

- Vectorisation et stockage : chaque morceau est transformé en vecteur (une représentation mathématique de son sens) et rangé dans une base vectorielle.

- Retrieval et génération : quand un utilisateur pose une question, le système trouve les morceaux les plus pertinents par similarité, puis demande au LLM de formuler une réponse à partir de ces morceaux.

Les choix qui comptent vraiment dans cette chaîne ne sont pas le modèle LLM. Ce sont :

- La qualité du chunking. Mal découper un document (par exemple couper une clause contractuelle en deux), c'est dégrader toutes les réponses qui suivent. C'est l'étape la plus sous-estimée.

- La fraîcheur des données. Vos documents évoluent. Le pipeline d'ingestion doit savoir détecter les changements et ré-indexer. Sans ça, vous répondez à partir de versions périmées.

- Le contrôle d'accès. Si votre commercial peut interroger la base et tomber sur les salaires, c'est cuit. Le RAG doit respecter les droits d'accès en amont, pas filtrer en aval.

Côté outils en 2026, deux philosophies. Le prêt-à-l'emploi : Claude Projects, Notion AI, NotebookLM, ChatGPT Team. Vous balancez vos documents, vous obtenez un RAG en 10 minutes, vous ne contrôlez ni le chunking ni la vectorisation. Suffisant pour 80 % des besoins de niveau périphérique. Le sur-mesure : stack maison avec LangChain ou LlamaIndex, base vectorielle type Pinecone ou Qdrant, hébergement contrôlé. Plus de travail, plus de contrôle, plus cher. Indispensable dès qu'il y a des contraintes fortes de confidentialité, de volume ou d'intégration.

Pour la plupart des PME, un RAG est ce que j'appelle un "niveau 1" dans une démarche d'intégration progressive : un outil périphérique qui ne touche pas le SI critique. J'ai détaillé cette approche en trois niveaux dans comment intégrer l'IA en PME sans casser l'existant. Le RAG y a sa place, mais comme première brique, pas comme stratégie.

Les 4 erreurs qui plantent un projet RAG

Ces quatre erreurs reviennent en boucle. Si vous lancez un projet RAG, vérifiez que vous n'êtes dans aucune des quatre.

1. Pas de gouvernance d'accès. Le RAG est branché sur l'ensemble des documents de l'entreprise sans filtre de permissions. Résultat : un commercial qui demande "quelle est la grille salariale" obtient la réponse. Un stagiaire qui demande "quels sont les comptes-clients les plus stratégiques" obtient la liste. C'est une bombe à retardement. La règle : les droits d'accès aux documents doivent être appliqués au moment du retrieval, pas après.

2. Pas de mesure du taux de réponses correctes. L'outil est déployé, les équipes l'utilisent, personne ne sait s'il dit la vérité. Sans benchmark de qualité (un jeu de 50 à 100 questions de référence avec leurs réponses attendues, qu'on rejoue à chaque mise à jour), vous déployez à l'aveugle. Le jour où le RAG se met à raconter n'importe quoi sur un sujet sensible, vous le découvrez par un client mécontent.

3. RAG sur données mal structurées. PDF scannés sans OCR propre, doublons partout, versions multiples du même document sans indication de la plus récente, formats hétérogènes. Le LLM va halluciner pour compenser le bruit. Le RAG révèle impitoyablement l'état réel de votre base documentaire. Si elle est sale, ce n'est pas l'IA qu'il vous faut d'abord, c'est un ménage.

4. Pas de fallback "je ne sais pas". Un LLM mal configuré préfère inventer une réponse plausible plutôt que d'avouer qu'il n'a pas l'information. Le RAG doit être paramétré pour répondre "je n'ai pas trouvé d'information fiable sur ce point dans la base" quand c'est le cas. Sans ce garde-fou, vous obtenez des réponses confiantes sur des sujets qui ne sont pas dans la base. Le pire des deux mondes.

Quand faire appel à un consultant vs partir en interne

Trois critères pour trancher.

Volume documentaire. Sous 50 documents, vous n'avez probablement pas besoin de RAG du tout. Entre 50 et quelques centaines de documents non sensibles, un Claude Projects ou un NotebookLM monté en interne par un product manager peut suffire. Au-delà de quelques milliers de documents, ou si vous avez besoin de pipelines d'ingestion automatisés, c'est un projet qui mérite un accompagnement technique.

Sensibilité des données. Si vos documents contiennent des informations confidentielles (contrats, RH, données clients identifiables, propriété intellectuelle), la question de l'hébergement et du contrôle d'accès devient critique. Un outil grand public type ChatGPT Team peut suffire pour de la doc technique publique. Pour des données régulées (RGPD, données de santé, secteurs régulés), il faut une stack contrôlée et une vraie réflexion sur le déploiement.

Intégration au SI. Tant que le RAG reste un outil isolé branché sur un dossier de documents, c'est gérable en interne. Dès qu'il faut le connecter à votre CRM, à votre ERP, à votre base support, ou industrialiser le pipeline d'ingestion, vous entrez dans un projet d'intégration qui dépasse l'outil prêt-à-l'emploi.

La règle pratique : commencez en interne avec un outil prêt-à-l'emploi pour valider l'usage et l'appétit des équipes. Ça coûte quelques centaines d'euros et deux semaines. Si l'usage prend et que vous touchez les limites du prêt-à-l'emploi (volume, sensibilité, intégration), c'est à ce moment-là qu'un accompagnement devient pertinent.

Le détail de ma méthode et de mes interventions sur ces sujets est sur ma page consultant IA.

FAQ

Combien coûte un RAG en PME en 2026 ?

Trois fourchettes selon l'ambition. RAG sur outil prêt-à-l'emploi (Claude Projects, Notion AI, NotebookLM) : entre 20 et 60 euros par utilisateur et par mois en licences, sans coût de mise en place. RAG sur stack contrôlée (LangChain ou LlamaIndex, base vectorielle managée, hébergement cloud) : entre 8 et 20k euros pour la mise en place, plus 200 à 1500 euros par mois de coûts d'infra et d'API. RAG sur stack souveraine avec multi-corpus, permissions fines et intégration au SI : entre 25 et 60k euros pour la mise en place, plus l'infrastructure. Le coût marginal par requête, dans tous les cas, reste faible : quelques centimes par interrogation.

Combien de temps prend un déploiement RAG ?

Outil prêt-à-l'emploi : 1 à 2 semaines, le temps de préparer la base documentaire et de cadrer les premiers usages. Stack contrôlée avec quelques milliers de documents : 4 à 8 semaines, incluant l'ingestion, le tuning du chunking, le benchmark de qualité et le déploiement. Stack industrialisée avec pipeline d'ingestion automatisé, contrôle d'accès fin et intégration au SI : 8 à 16 semaines. Dans tous les cas, prévoyez 2 à 4 semaines supplémentaires pour stabiliser l'usage en production et ajuster en fonction des retours utilisateurs.

Quelle différence entre fine-tuning et RAG ?

Le fine-tuning consiste à ré-entraîner un modèle sur vos données pour qu'il les "apprenne". Le RAG laisse le modèle tel quel et lui donne accès à vos données au moment de la question. Conséquences pratiques : le fine-tuning est coûteux, lent à mettre à jour (chaque évolution de la base demande un ré-entraînement), et adapté quand vous voulez modifier le style ou les comportements du modèle. Le RAG est rapide à mettre à jour (il suffit de ré-indexer les nouveaux documents), adapté quand vous voulez interroger des informations factuelles, et nettement moins cher. Pour la quasi-totalité des cas d'usage PME, c'est RAG qu'il vous faut, pas fine-tuning.

Mes données partent-elles chez OpenAI ou Anthropic si je fais un RAG ?

Ça dépend de la stack. Avec un outil prêt-à-l'emploi grand public, vos données passent par les serveurs du fournisseur (avec des engagements contractuels variables sur la non-utilisation pour l'entraînement). Avec Claude Enterprise, Azure OpenAI ou OpenAI Enterprise, les contrats incluent des garanties de non-utilisation des données pour l'entraînement et des options d'hébergement régional. Avec un déploiement souverain (modèle open-source type Mistral ou Llama, hébergé sur votre cloud privé), vos données ne sortent jamais de votre infrastructure. Le bon choix dépend de la sensibilité de vos documents et de votre cadre réglementaire.

En clair

Le RAG en entreprise n'est pas une stratégie IA. C'est une brique. Elle est utile dans cinq contextes précis (doc technique, RH, contrats, devis, appels d'offres) et inutile dans trois (données qui changent en permanence, faible volume documentaire, besoins de calcul plutôt que de récupération).

La vraie question à se poser avant de lancer un projet RAG n'est pas "comment on fait un RAG". C'est : "ai-je un problème de récupération de connaissance interne mesurable, sur un volume qui justifie cette architecture, avec une base documentaire suffisamment propre". Si la réponse est oui, le RAG est un excellent levier. Si la réponse est non, le RAG sera un POC de plus qui meurt en silence.

Si vous voulez un échange de 30 minutes pour voir si le RAG a du sens dans votre contexte, ou pour cadrer un projet déjà en cours qui patine, le formulaire est juste ici. Pas de slides, pas de pitch. Un échange honnête.